- Sigmoid

- Posts

- Cum poți transforma visele în videoclipuri?

Cum poți transforma visele în videoclipuri?

Ține pasul cu cele mai relevante inovații din AI și tehnologie!

Howdy Dragi Sigmariteni

Vrei să afli cum AI revoluționează coding-ul, analizează mutațiile genetice și simplifică rezolvarea sarcinilor complexe? Sau cum poți genera secvențe audio doar în baza textului? Care sunt cele mai noi inovații de la OpenAI, Google sau Anthropic? Cum poți transforma visele în videoclipuri? Cum poți transforma fotografiile direct în poezii sau ce inovații și modele noi au fost lansate?

Cum poți să îți transformi visele în clipuri video?

Modem a implimentat Dream Recorder, un AI ce transformă visele povestite în clipuri video. Dream Recorder este un dispozitiv care captează viziunile nocturne și le redă ca înregistrări cinematografice vii. Utilizatorii se trezesc dimineața, apasă un buton și povestesc visele din noaptea precedentă în orice limbă, iar AI-ul generează un video reel care se redă pe ecranul dispozitivului într-un stil impresionist. Sistemul folosește Luma AI pentru a transforma povestirile în videoclipuri, care sunt inteționat cețoase și cu detalii reduse pentru a imita modul în care ne amintim visele - nu cu precizie, ci prin impresii vagi și emoții. Dezvoltat de studioul olandez Modem Works din Amsterdam în colaborare cu Mark Hinch, Ben Levinas, Joe Tsao și artistul Alexis Jamet, dispozitivul este open-source și poate fi asamblat din componente comerciale și piese printate 3D.

Poate AI să înțeleagă mai bine emoțiile ca oamenii?

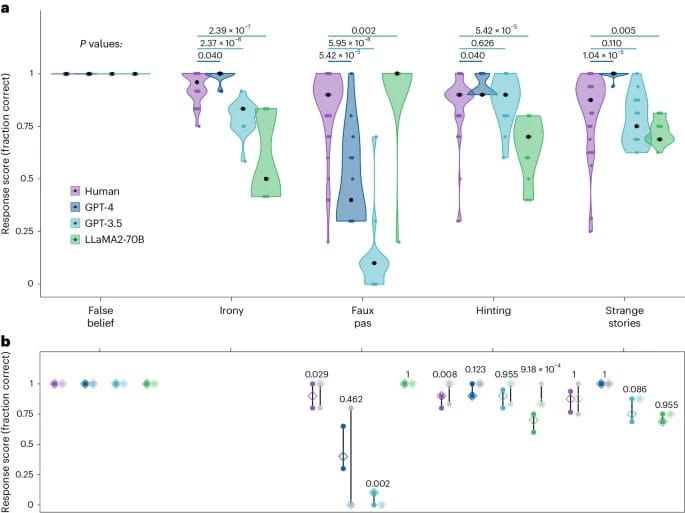

Un studiu publicat în revista Communications Psychology arată că modelele AI au demonstrat performanțe superioare oamenilor în testele de inteligență emoțională. Cercetătorii au evaluat șase modele avansate de limbaj, incluzând ChatGPT-4, ChatGPT-o1, Claude 3.5 Haiku, Copilot 365, Gemini 1.5 Flash și DeepSeek V3, folosind cinci teste psihologice standard pentru măsurarea inteligenței emoționale.

Rezultatele sunt remarcabile: modelele AI au obținut o acuratețe medie de 81%, în timp ce oamenii au înregistrat doar 56% în aceleași teste. ChatGPT-4 s-a evidențiat nu doar prin performanța sa superioară, ci și prin capacitatea de a genera noi itemi de test, cu proprietăți psihometrice similare cu cele originale, demonstrând o înțelegere profundă a structurii testelor de inteligență emoțională.

Totuși, experții avertizează că, deși AI-ul pare să "înțeleagă" emoțiile mai bine decât oamenii în contexte specifice de testare, această performanță nu înseamnă neapărat că sistemele AI au o adevărată empatie sau înțelegere emoțională similară cu cea umană, ci mai degrabă o capacitate superioară de a recunoaște tipare și de a procesa informații emoționale.

Modelul care prezice acțiunile în medii necunoscute

Meta a creat V-JEPA 2, un model AI care poate înțelege și prezice lumea fizică. Astfel de modele sunt folosite în roboți pentru a înțelege lumea reală. V-JEPA 2 este un model cu 1.2 miliarde de parametri antrenat pe video pentru a sprijini înțelegerea, predicția și planificarea în sistemele robotice. Modelul permite roboților să interacționeze cu obiecte și medii necunoscute pentru a completa o sarcină, Meta susținând că V-JEPA 2 este de 30 de ori mai rapid decât modelul Cosmos de la Nvidia. V-JEPA 2 poate ajuta la crearea de aplicații AI care necesită predicția rezultatelor și planificarea acțiunilor în medii imprevizibile cu multe cazuri extreme, oferind o cale clară către roboți mai capabili și automatizare avansată în medii fizice.

Digitalizează acum documentele într-un timp de 180 de ori mai scurt

Guvernul Marii Britanii a creat Extract, un tool ce le va permite să digitalizeze documentele pe hârtie în doar 40 de secunde per document. Noul instrument AI generativ dezvoltat în colaborare cu Google poate transforma documente vechi de planificare urbană - inclusiv hărți neclare și note scrise de mână - în date digitale, reducând drastic timpul de 1-2 ore necesar anterior planificatorilor. Extract poate scana sute de fișiere în câteva secunde, ajutând consiliile să convertească documente de planificare vechi de decenii într-un format digital utilizabil. Instrumentul face parte din ambițiosul plan al guvernului de a digitaliza complet sistemul de planificare urbană pentru a facilita construirea a 1,5 milioane de case noi. Tehnologia va elibera responsabilii de planificare să se concentreze pe aplicații în loc de gestionarea datelor, transformând informațiile captive în hărți pe hârtie și PDF-uri în date digitale utilizabile.

Apple WWDC 2025: noutăți și lansări

În cadrul WWDC 2025, Apple a lansat:

Liquid Glass, un nou design pentru toate sistemele Apple. Acest nou limbaj vizual introduce elemente transparente, cu aspect sticlos, reprezentând cea mai extinsă renovare de design din partea Apple de după iOS 7. Designul Liquid Glass păstrează fundamentele estetice flat existente, dar le îmbogățește cu elemente UI mai transparente și un aspect mai elegant, fiind aplicat pe întreaga gamă de sisteme de operare Apple.

Împreună cu Liquid Glass se lansează iOS 26, macOS Tahoe și versiunea 26 a celorlalte sisteme Apple. macOS Tahoe (denumit după Lacul Tahoe din California) va fi lansat în această toamnă și include noi aplicații precum Games app, actualizări la Spotlight și funcționalități preluate de pe iPhone.

iOS 26, care va implementa Liquid Glass, va avea o interfață mai fluidă și un redesign al aplicațiilor precum Camera, Galerie și altele. Sistemul include, de asemenea, o aplicație Phone redesignată, funcții de traducere în timp real și suport pentru ecrane multitouch în CarPlay.

Car Play Ultra este noul sistem integrat în mașini, care îți va permite să pornești mașina direct din aplicația Apple. CarPlay Ultra unifică cea mai bună experiență de pe iPhone cu cea mai bună din mașină, oferind o experiență integrată și personalizată pe toate displayurile din vehicul, incluzând aplicațiile preferate din CarPlay actual.

Foundational Models Frameworks este un framework ce oferă acces dezvoltatorilor pentru a folosi Apple Intelligence. Noul framework permite dezvoltatorilor terți să utilizeze modelul de limbaj de aproximativ 3 miliarde de parametri care alimentează Apple Intelligence, oferind acces prin API Swift convenabil pentru crearea de funcționalități AI personalizate în aplicațiile lor, inclusiv generarea de text și imagini.

Cursor 1.0: versiunea actualizată

Cursor, un code editor care folosește AI a lansat versiunea 1.0, marcând o etapă importantă în evoluția acestui instrument. Principala noutate este BugBot, o funcționalitate care analizează automat pull request-urile și identifică potențiale bug-uri și probleme în cod, lăsând comentarii utile pentru dezvoltatori.

Versiunea 1.0 introduce și Background Agent, care permite editarea codului într-un mediu îndepărtat, precum și funcționalitatea Memories, care stochează și face referință la informații din conversațiile anterioare cu AI-ul. De asemenea, noua versiune aduce suport pentru Jupyter notebooks și o configurare simplificată cu un singur click pentru MCP.

Care sunt cele mai noi inovații de la Google?

Google a lansat Gemini CLI, un agent AI open-source pentru terminale. Instrumentul oferă acces direct la modelele Gemini în linia de comandă, fiind disponibil gratuit pentru dezvoltatori pe Mac, Windows și Linux, cu o interfață care acceptă comenzi în limbaj natural. Gemini CLI utilizează un mecanism ReAct loop care se conectează cu instrumentele locale și serverele MCP pentru a finaliza sarcini complexe precum identificarea și rezolvarea bug-urilor, crearea de aplicații noi sau analiza unor baze de cod extinse. Agentul poate procesa și manipula fișiere, executa comenzi de sistem și oferă suport pentru depanare, toate prin intermediul unei interfețe bogate și intuitive.

Google a creat Magenta RealTime, un AI muzical live ce permite creare sau mixaj în timp real. Modelul permite generarea continuă de audio muzical, ghidat de prompt-uri text, exemple audio sau o combinație ponderată a mai multor prompt-uri text și/sau exemple audio, oferind controlul dinamic asupra stilului și direcției muzicii generate. Magenta RealTime este construit pe un Transformer cu 800 milioane de parametri și antrenat pe aproximativ 190.000 de ore de muzică predominant instrumentală.

Google a introdus Search Live, un mod AI cu conversații vocale și rezultate web în timp real. Funcționalitatea permite utilizatorilor să aibă conversații naturale cu Google Search prin voce, primind răspunsuri audio generate de AI și link-uri relevante de pe web, fiind ideal pentru situațiile în care sunt în mișcare sau se ocupă cu alte activități. Pentru a accesa Search Live, utilizatorii trebuie să se înscrie în experimentul AI Mode prin Google Labs în aplicația Google pentru Android și iOS. După înregistrare, apare o nouă pictogramă "Live" sub bara de căutare, care permite începerea imediată a conversațiilor vocale.

Google a lansat Gemini 2.5 Flash-Lite, cel mai rapid și eficient model al său de până acum. Disponibil acum în Google AI Studio și Vertex. Disponibil acum în Google AI Studio și Vertex. Acest nou model oferă performanțe superioare comparativ cu versiunea anterioară Flash-Lite, fiind cu 1,5 ori mai rapid decât modelul 2.0 Flash și la un cost mai mic pe platforma Vertex AI. Gemini 2.5 Flash-Lite este optimizat pentru cazuri de utilizare cu latență redusă și este considerat cel mai echilibrat model Gemini, fiind ideal pentru sarcini precum clasificarea, traducerea, rutarea inteligentă și alte operațiuni cost-eficiente la scară mare. O caracteristică distinctă a modelului este că include capacități de raționament, permițând controlul dinamic al bugetului de "gândire" printr-un parametru API. Aceasta înseamnă că dezvoltatorii pot ajusta cât de mult să "gândească" modelul înainte de a furniza un răspuns, oferind flexibilitate în echilibrul dintre viteză și calitatea răspunsului.

Google a lansat Edge AI Gallery, o aplicație open source de rulare a modelelor AI pe telefon. Aplicația permite utilizatorilor să descarce și să execute modele AI de pe platforma populară Hugging Face în întregime pe dispozitivele lor, oferind capabilități precum analiza imaginilor, generarea de text, asistența pentru cod și conversații cu mai multe ture, toate datele fiind procesate local. Edge AI Gallery este disponibilă pentru Android, cu suport pentru iOS care va fi lansat curând. Modelele rulează offline, fără a necesita o conexiune la internet, exploatând puterea de procesare a dispozitivelor moderne. Aplicația suportă mai multe modele AI open-source, inclusiv propriul model Gemma 3n al Google, oferind utilizatorilor acces privat și cu latență redusă la tehnologia AI.

Cum poți transforma fotografiile direct în poezii?

O echipă din New York, în colaborare cu Anthropic, a lansat o cameră care scrie poezii în baza imaginii captate de camera. Creată de Kelin Carolyn Zhang și Ryan Mather, cu ajutorul acestei invenții fotografiezi o scenă și în loc de o fotografie, primești o poezie proaspăt tipărită, un fragment de vers generat de AI inspirat din ceea ce vede camera. Poetry Camera tipărește poezii generate de AI instantaneu, fără să stocheze imagini sau fișiere digitale, folosind Claude 4 de la Anthropic pentru a crea poezii în diverse formate, inclusiv haiku-uri și sonete. Există două variante ale camerei poetice: una completă, rafinată și elegantă, vândută pentru 699 de dolari cu livrare așteptată din septembrie 2025, și o versiune DIY pentru cei care vor să experimenteze cu electronica do-it-yourself.

Noul model V1 de la Midjourney

Midjourney a lansat modelul video V1 care transformă imagini în clipuri video de 5 secunde. Modelul V1 poate anima orice imagine - fie generată de modelele Midjourney, fie încărcată de utilizator - producând patru variante de videoclipuri de 5 secunde fiecare. Utilizatorii pot extinde videoclipurile inițiale cu incremente de 4 secunde până de patru ori, ajungând la o durată maximă de 21 de secunde. Instrumentul este disponibil exclusiv pe website-ul midjourney.com și costă de 8 ori mai mult decât o generare de imagine, ceea ce înseamnă aproximativ costul unei imagini pe secundă de video. Modelul permite utilizatorilor să adauge prompt-uri text opționale pentru a ghida mișcarea și să folosească o setare de animație automată care creează mișcări aleatorii.

Cum pot LLM-urile să își actualizeze propriii parametri?

MIT a creat o metodă prin care LLM-urile se pot adapta prin generarea de date. Cercetătorii de la MIT au dezvoltat framework-ul SEAL (Self-Adapting LLMs), care permite modelelor de limbaj să își actualizeze propriile parametri prin generarea autonomă de date de antrenament și directive de update. Spre deosebire de modelele tradiționale care sunt statice după lansare, SEAL învață să producă "self-edits" - generări care restructurează informația în moduri diferite și specifică obiective de optimizare pentru sine însuși. Când primește un input nou, modelul generează automat date de fine-tuning relevante și instrucțiuni despre cum să se modifice pentru a îmbunătăți performanța la task-ul respectiv. Framework-ul folosește reinforcement learning pentru a antrena LLM-urile să genereze aceste auto-editări eficiente.

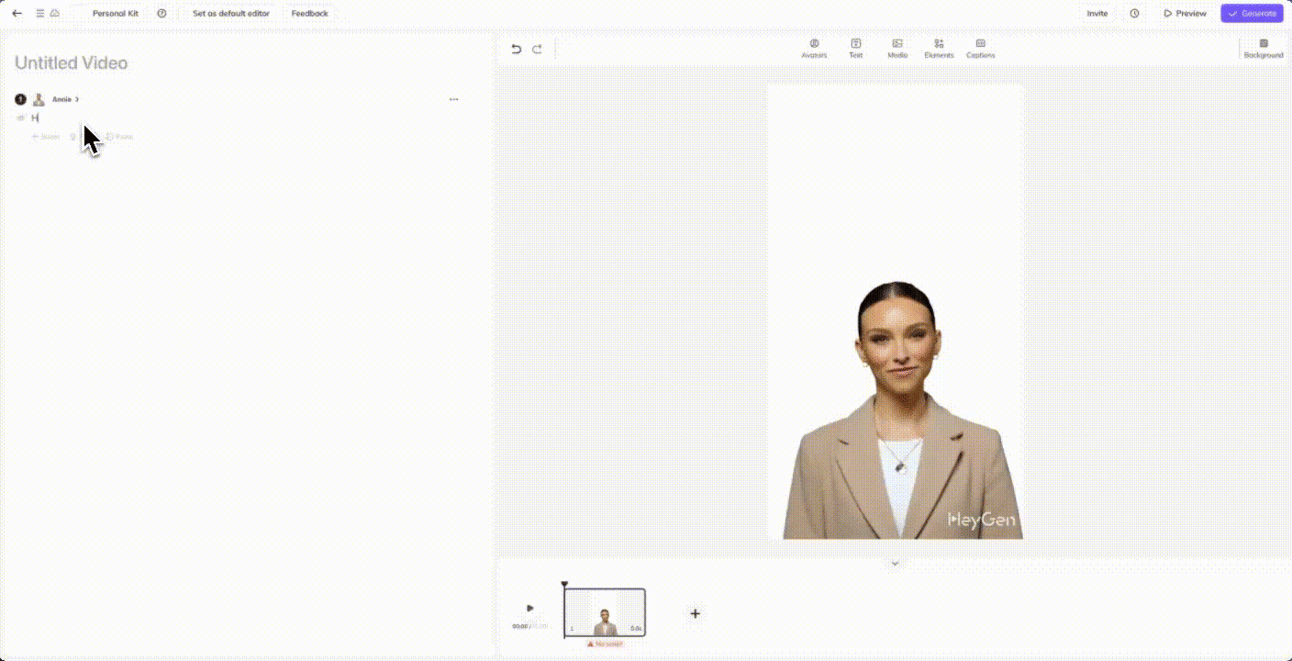

Personalizează-ți avatarul până la cel mai mic detaliu

HeyGen a lansat AI Studio, o nouă suită de tools de editare video care îți permite să creezi caractere umaniste și să le animezi. Noua platformă înlocuiește timeline-ul tradițional de editare cu un editor bazat pe script, permițând utilizatorilor să creeze videoclipuri prin simpla editare a textului, transformând astfel procesul de producție video într-o experiență mai intuitivă și accesibilă. AI Studio oferă control total asupra avatarilor AI, permițând dirijarea tonului, gesturilor, ritmului și expresiilor folosind limbaj natural sau eșantioane de voce. Platforma include funcționalități avansate precum Camera Control, care permite creatorilor să dirijeze mișcările camerei virtuale, adăugând eleganță cinematografică și unghiuri dinamice fără a folosi echipament fizic de filmare.

Ochelari AI în timpul sportului?

Meta și Oakley au lansat Oakley Meta HSTN, ochelari sport cu AI și cameră Ultra HD. Noii ochelari sport integrează o cameră ultra-wide de 12MP capabilă să înregistreze conținut în 3K (2.880 x 1.620 pixeli), o îmbunătățire semnificativă față de rezoluția 1080p a modelelor Meta Ray-Ban anterioare. Ochelarii oferă până la 8 ore de utilizare tipică și aproape 19 ore în standby, cu încărcare rapidă la 50% în doar 20 de minute și o carcasă care furnizează încă 48 de ore de autonomie. Dispozitivul are clasificare IPX4 pentru rezistența la apă, difuzoare Bluetooth integrate și poate fi controlat hands-free pentru fotografii, videoclipuri POV, apeluri video și livestreaming. Meta AI integratul poate răspunde la întrebări despre ceea ce vezi prin cameră, fiind destinat în special sportivilor și activităților outdoor. Prețul pornește de la 399$ pentru versiunea standard, cu o ediție limitată la 499$ disponibilă pentru precomandă din 11 iulie, lansându-se inițial în 16 țări.

Poate AI prezice cum anumite mutații pot activa gene specifice?

DeepMind a lansat AlphaGenome, un AI care analizează mutații ADN. AlphaGenome poate procesa secvențe lungi de ADN și să prezică cum mutațiile singulare sau variantele genetice afectează reglarea genelor și producția de proteine. Instrumentul abordează "materia întunecată" din genomul uman - secvențele non-codificate care reprezintă 98% din ADN-ul nostru dar ale căror funcții rămân misterioase. AlphaGenome poate replica mecanismele cunoscute ale bolilor prin predicția că anumite mutații vor activa gene specifice, cum ar fi gena TAL1 prin introducerea unui motiv de legare ADN MYB. Modelul permite cercetătorilor să efectueze virtual experimente care anterior necesitau laborator fizic, accelerând semnificativ cercetarea genetică.

Ce inovații și inițiative a implementat OpenAI?

OpenAI a lansat Record Mode în ChatGPT, pentru transcrierea și rezumarea automată a înregistrărilor audio. Această nouă funcționalitate este disponibilă în aplicația desktop macOS pentru utilizatorii Pro, Team, Enterprise și Edu, permițând înregistrarea audio de până la 120 de minute pe sesiune, cu transcriere și sumarizare în timp real. Record Mode transformă întâlnirile, sesiunile de brainstorming sau notițele vocale în documente organizate și editabile. Funcționalitatea capturează audio-ul, îl transcrie automat într-un rezumat editabil și îl face accesibil pentru căutare, analiză sau pentru generarea de rezumate, email-uri și chiar cod. ChatGPT poate procesa aceste înregistrări pentru a oferi perspective structurate și acționabile asupra conținutului discutat.

OpenAI a lansat opțiunea de a oferi acces la internet lui codex, un software-engineer agent. Acum acesta poate căuta informații online când scrie cod. Această nouă capabilitate permite agentului să instaleze dependențe de bază, să ruleze teste care necesită resurse externe și să actualizeze sau să instaleze pachete, deschizând noi posibilități pentru automatizarea sarcinilor de dezvoltare.

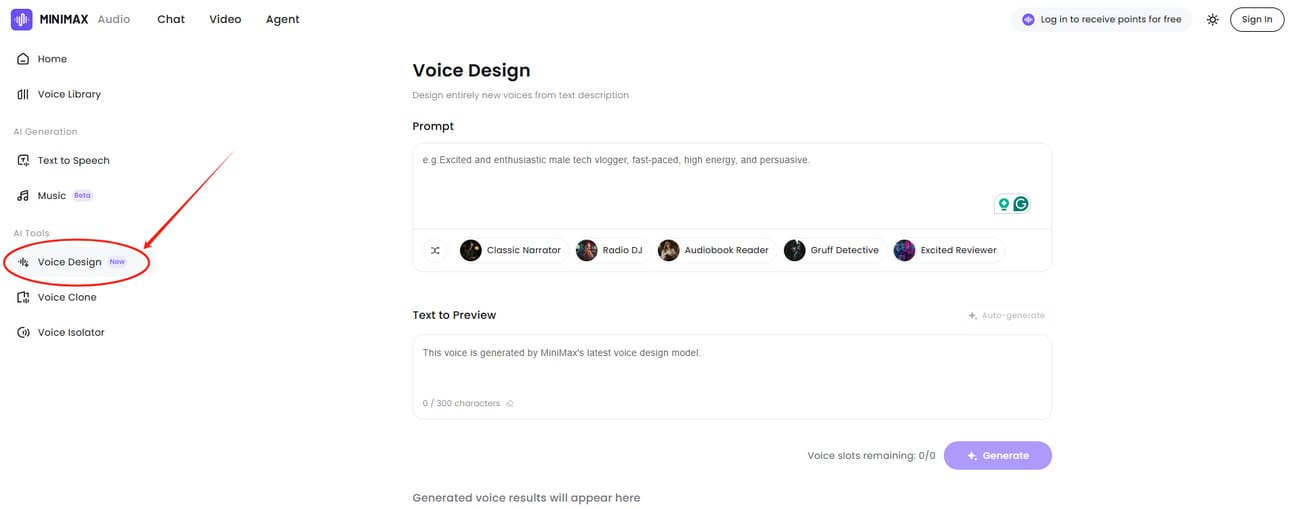

Cum poți crea audio din text în mai multe limbi?

MiniMax a lansat Voice Design, un generator vocal personalizat care creează audio din text în mai multe limbi. Noul model Speech-02 oferă voci ultra-realiste cu o similaritate de 99% față de originalul uman și poate clona orice voce dintr-o înregistrare de doar 5 secunde. Instrumentul suportă peste 30 de limbi și dialecte, inclusiv accente regionale pentru rezultate mai autentice, putând procesa texte de până la 200.000 de caractere în una dintre cele mai impresionante capabilități de lungime din domeniu. Voice Design integrează MCP pentru conectare cu alte instrumente AI și poate citi direct fișiere sau URL-uri pentru a converti conținut în vorbire. Platforma oferă un API cost-eficient care este de 10 ori mai ieftin decât competitorii, folosind un model pay-per-use fără abonamente lunare.

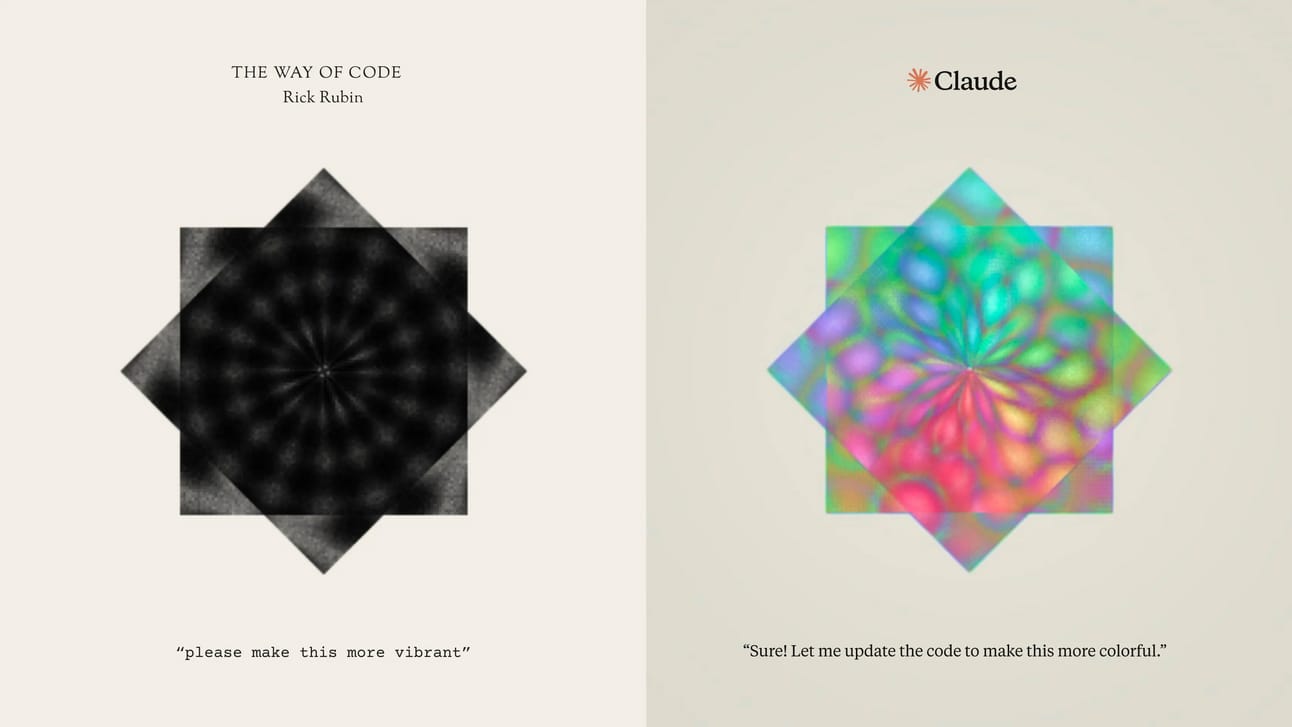

Artifacts și Claude Code actualizat

Anthropic a introdus Artifacts, un mod Claude pentru crearea de aplicații AI direct în chat. Această funcționalitate permite utilizatorilor să creeze aplicații interactive, jocuri și instrumente printr-o conversație simplă cu Claude, fără a necesita cunoștințe de programare. Artifacts sunt secțiuni de cod independente pe care Claude le creează în timpul conversațiilor, afișate într-un panou dedicat alături de chat, făcându-le ușor de vizualizat, editat și cu care să interacționezi în timp real. Recent, Anthropic a îmbunătățit această funcționalitate, permițând utilizatorilor să creeze aplicații AI interactive cu Claude integrat direct în aplicație, oferind acces la o galerie publică de aplicații create de comunitate. Utilizatorii pot acum să activeze opțiunea "Create AI-powered artifacts" din setări pentru a dezvolta aplicații care permit conversații cu Claude direct în interfață. Aceste aplicații pot varia de la simple calculatoare la jocuri complexe sau instrumente de productivitate. Funcționalitatea este disponibilă pentru utilizatorii cu planuri Free, Pro și Max, fiind accesibilă atât pe web cât și pe aplicațiile mobile iOS și Android.

Anthropic a adăugat suport MCP remote în Claude Code cu autentificare OAuth, fără server local. Această actualizare permite dezvoltatorilor să conecteze instrumente și surse de date favorite pentru a personaliza experiența de codare fără a fi nevoie să gestioneze servere locale. Claude Code poate accesa atât instrumentele cât și resursele expuse de serverele MCP, oferindu-i capacitatea de a integra funcționalități externe direct în fluxul de lucru. Claude Code suportă SSE și servere HTTP pentru comunicarea în timp real, utilizând comanda /mcp pentru autentificarea cu servere remote care necesită autentificare OAuth 2.0. Serverele MCP pot fi configurate la trei nivele diferite de acces, fiecare servind scopuri distincte pentru managementul configurărilor.